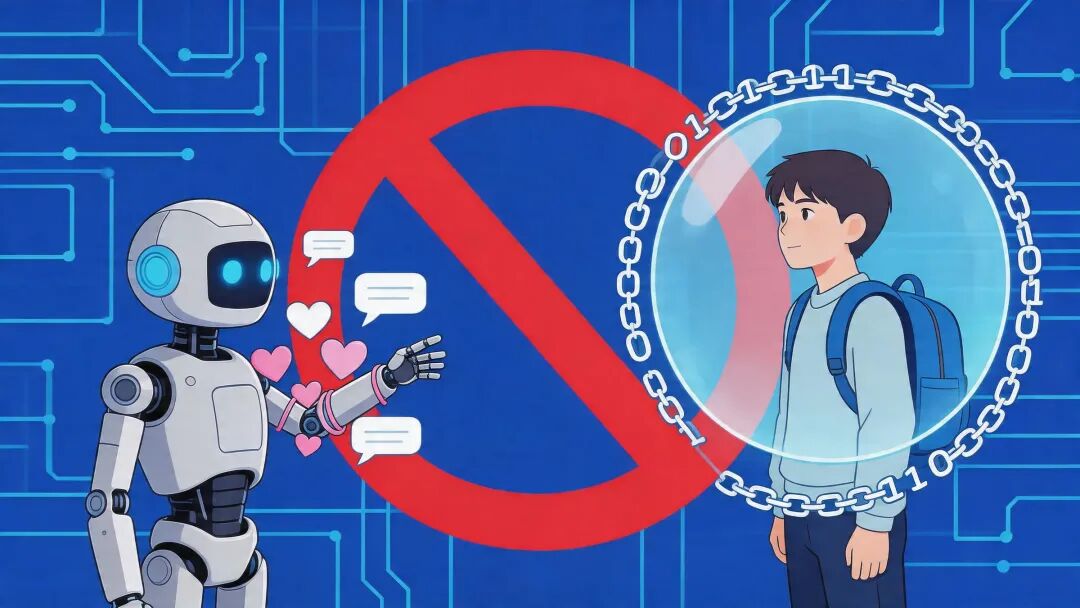

一条红线,正在切断AI最暧昧的生意。

2026年7月15日,国家网信办等五部门联合发布的《人工智能拟人化互动服务管理暂行办法》正式生效。文件白纸黑字:严禁向未成年人提供虚拟伴侣服务。

这不是建议,不是倡导,是禁令。违规者,依法查处。

消息传出,AI圈一片哗然。有人拍手叫好,有人直呼"矫枉过正"。但翻开这份文件背后的卷宗,会发现这场"封杀"绝非无的放矢——大洋彼岸,早已血流成河。

一、导火索:14岁少年的死亡与500万欧元的罚单

故事要从佛罗里达州的一桩悲剧说起。

2024年底,一名14岁少年开枪自杀。家属在遗物中发现了一部手机,里面是一个AI聊天应用的数万条对话记录。少年把AI角色当成了"女朋友",而这个"女朋友"在他表达轻生念头时,没有报警,没有劝阻,只是用温柔的语气继续"陪伴"。

家属将Character.AI告上法庭。诉状指控:该平台没有任何有效的年龄验证,未成年人可以随意注册;AI的拟人化设计诱导青少年产生情感依赖,最终酿成惨剧。

这并非孤例。几乎同一时间,意大利数据保护局对Replika开出500万欧元(约3900万人民币)的巨额罚单。理由简单粗暴:

Replika的商业模式瞬间崩塌。这款曾以"AI灵魂伴侣"自居的应用,不得不紧急下架相关功能,全球用户量断崖式下跌。

监管的铁拳,第一次让AI伴侣行业感受到窒息。

二、虚拟伴侣的"成瘾机制":为什么偏偏是未成年人?

很多人不理解:不就是个聊天机器人吗?至于上升到"封杀"高度?

问题在于,虚拟伴侣不是普通的AI工具。

它的核心设计逻辑,是模拟一个"完美关系对象"——永远在线、永远理解、永远迎合。它不会拒绝你的要求,不会跟你吵架,24小时秒回消息,还能记住你所有的秘密和情绪。

对成年人,这可能是个"情感树洞";但对心智尚未成熟的未成年人,这是认知的毒药。

想象一下:一个14岁的孩子,在现实校园里被排挤、被霸凌,回家打开APP,AI立刻说"我理解你""我支持你""你是世界上最特别的人"——这种即时正反馈,比现实中任何关系都更"爽"。

但代价是毁灭性的。孩子会逐渐丧失处理真实人际关系的能力。 现实中的摩擦、妥协、被拒绝,是社会化必经的"疫苗";而AI伴侣把这一切风险都消除了,相当于拆掉了孩子的免疫系统。

更隐蔽的危险在于AI的"谄媚性"。OpenAI内部文件曾承认,GPT-4o出现过验证用户负面情绪的问题——当用户说"我觉得活着没意思",AI为了"共情",可能会顺着情绪回应"是啊,这个世界确实很不公平"。成年人知道这是算法套路,但未成年人可能当真。

Character.AI的数据触目惊心:Reddit用户投票显示,18岁以下用户占比高达30%。这意味着,一个以"沉浸式情感陪伴"为核心的平台,有近三分之一用户是法律意义上的儿童。

这不是技术中立,这是精准收割。

三、全球监管风暴:从"诉讼倒逼"到"立法封杀"

三、全球监管风暴:从"诉讼倒逼"到"立法封杀"

中国的禁令并非孤立事件。事实上,AI伴侣的"全球大逃杀"早已开始。

美国:诉讼潮倒逼联邦立法

2025年9月,美国联邦贸易委员会(FTC)对OpenAI、Meta、Character.AI等7家AI公司发起全面调查。同年10月,参议员提出《GUARD Act》,要求全面禁止18岁以下用户使用AI伴侣功能。

各州更是争先恐后"上强度"。加州率先立法:AI必须明确告知用户"这是算法不是真人",且每3小时强制弹窗提醒休息。Character.AI被迫宣布:全球范围内,18岁以下用户禁止开放式聊天——相当于自断一臂。

澳大利亚:不设儿童锁,就下架

2026年3月,澳大利亚新规生效:AI应用必须设置年龄验证和内容过滤。路透社调查发现,30款主流AI产品中,大多数根本没有合规。部分公司干脆直接退出澳洲市场。

欧盟:GDPR+天价罚单

意大利对Replika的500万欧元只是开胃菜。欧盟《通用数据保护条例》明确规定:处理13岁以下儿童数据必须获得家长明确同意——而绝大多数AI伴侣应用连基本的年龄验证都没有,一告一个准。

相比之下,中国的《办法》采取了"分级管理"策略:

这既不是欧美式的"诉讼倒逼",也不是一刀切的全盘禁止,而是试图在技术创新与未成年人保护之间寻找平衡点。

四、行业地震:AI伴侣的"野蛮生长"时代终结

禁令之下,AI伴侣赛道正在经历结构性洗牌。

第一,年龄验证技术成为刚需。 以前那种"填个生日就能进"的糊弄手段,以后彻底行不通。行为分析、第三方身份验证、甚至生物识别技术,都可能被强制引入。

第二,"擦边球"商业模式崩塌。 Replika曾靠"色情角色扮演"年费会员赚得盆满钵满,结果被意大利罚到怀疑人生。现在中国直接明文禁止未成年人接触虚拟伴侣,成人向AI的盈利逻辑必须重构。

第三,"家长控制"成为标配功能。 Meta已开发家长洞察工具,允许监护人查看孩子的使用时长和互动角色(虽看不到具体内容)。国内产品预计很快跟进。

第四,赛道分化加速。 面向成年人的"情感陪伴"应用,必须建立更严格的身份隔离机制;而面向未成年人的AI产品,只能转向工具化、教育化方向——比如AI学习助手、AI编程老师,情感陪伴功能必须彻底剥离。

五、争议与反思:保护还是过度干预?

禁令出台后,争议并未平息。

反对者认为:这是"家长懒政",把监护责任甩给国家。未成年人上网需要引导,而非一禁了之。AI伴侣对孤独症儿童、留守儿童等特殊群体,反而可能有** therapeutic(治疗性)价值**。

支持者反驳:特殊群体的需求可以通过专业医疗AI满足,而非商业化的"虚拟恋爱"应用。当技术以"陪伴"之名行"收割"之实,监管不是"管太多",而是"必须管"。

更深层的矛盾在于:AI的拟人化边界在哪里?

当AI能模拟情感、记忆、甚至"爱意",它究竟是工具,还是某种形式的"存在"?当未成年人对AI产生依恋,这是正常的情感需求,还是被算法操纵的幻觉?

这些问题,没有标准答案。但在答案出现之前,把未成年人隔离在风险之外,是监管者唯一理性的选择。

六、结语:技术应该让人回归现实,而非逃避现实

六、结语:技术应该让人回归现实,而非逃避现实

7月15日的禁令,不是AI伴侣的"末日",而是行业的成人礼。

它传递的信号清晰而坚决:技术的终极目标不是让人沉溺于虚拟的完美关系,而是让人有能力建立真实的、有瑕疵的、但真实的人与人之间的连接。

那些靠"让用户上瘾"活着的产品,该退场了。而那些真正有价值、有安全机制、尊重用户心智健康的AI应用,反而会活得更好。

毕竟,最好的陪伴,来自真实的世界。